Die Nadel im digitalen Heuhaufen

Über Algorithmen und Filterblasen

Medienradar, 05/2021

Was ist das eigentlich, diese Filterblase?

Gemäß dem Duden meint die Filterblase eine „selektive Informationsauswahl auf Webseiten durch Berücksichtigung des Nutzerverhaltens, -standorts o. ä.“[1] Das DigitalWiki formuliert noch etwas ausführlicher: „Der Begriff der Filterblase (auch Informationsblase) kommt aus der digitalen Welt und beschreibt das Phänomen, dass Webseite[n] und Plattformen mit Hilfe entsprechender Algorithmen den Einzelnen nur oder hauptsächlich Informationen und Meinungen einblenden, die mit den bisherigen Ansichten und Interessen weitgehend übereinstimmen.“[2] Gemeint ist demnach, dass Nutzer:innen nicht die gesamte Bandbreite der Inhalte im Internet angezeigt bekommen, sondern nur eine ihren Interessen entsprechende, auf sie zugeschnittene Auswahl. Der Rest wird quasi ausgeblendet.

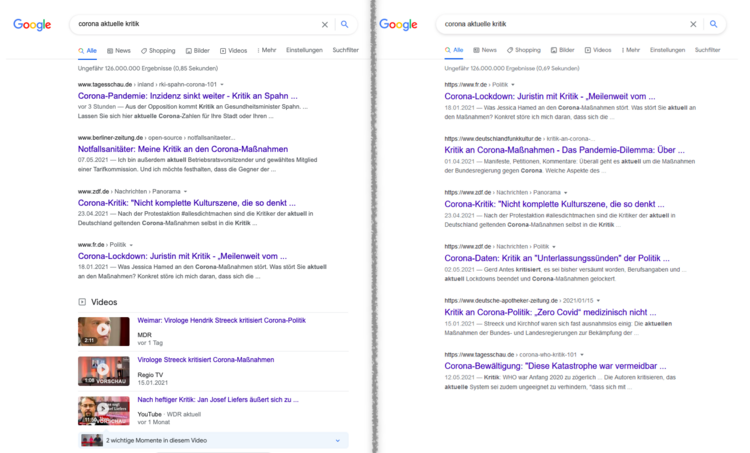

Geprägt wurde der Begriff durch den Internetaktivisten Eli Pariser, der ihn in seinem gleichnamigen Buch (The Filter Bubble) von 2011 verwendete und erstmals darauf aufmerksam machte, dass verschiedene Internetnutzer:innen beispielsweise bei der Eingabe eines Suchbegriffs in die Suchmaschine Google nicht die gleichen Inhalte angezeigt bekommen – sondern individuelle.

Zeig mir das, was mir gefällt!

Viele Internetseiten und Apps arbeiten mit sogenannten Algorithmen, die das Nutzungsverhalten und die Interessen der einzelnen User:innen auswerten und die Inhalte dann individuell filtern. Die auf diese Art selektierten Inhalte, die den Nutzer:innen angezeigt werden, entsprechen sehr wahrscheinlich ihren persönlichen Interessen, spiegeln ihre Meinungen am ehesten wider und sind auf ihre jeweiligen Geschlechter, ihr spezifisches Alter, ihre Vorlieben, ihre Standorte usw. zugeschnitten. Wiederum Inhalte, die sie sehr wahrscheinlich ohnehin nicht interessieren, bekommen sie gar nicht erst angezeigt. Auf den ersten Blick eine Win-win-Situation – die Nutzer:innen finden ihre Meinungen und Ansichten bestätigt und werden nicht mit „uninteressanten“ Inhalten belästigt. Die Anbieter freuen sich über hohe Besucherzahlen, da Nutzer:innen, die sich auf einem Portal wohlfühlen, dort auch länger verweilen. Davon profitieren sowohl die Website-Anbieter als auch die Werbeunternehmen, an die die Nutzerdaten weiterverkauft werden. Denn personalisierte Werbung ist deutlich effizienter.

Ein leicht nachvollziehbares Beispiel für einen solchen Algorithmus stellt die bei Kindern und Jugendlichen beliebte App TikTok dar, ein Portal für Kurzvideos, die oftmals nur 30 bis 60 Sekunden lang sind. Als Nutzer:in scrollt man einfach von einem Video zum nächsten. Dabei sind die Videos, die einem angezeigt werden, keineswegs willkürlich gewählt, sondern sie basieren zum einen auf den eigenen Interessen (Welchen Accounts folgt man? Welche Videos hat man gelikt?), zum anderen auf das Verhalten innerhalb der App (Welche Videos hat man sich angeschaut oder sich sogar mehrfach angesehen? Welche hat man schnell überblättert?). All diese Daten werden ausgewertet und der dahinterstehende Algorithmus passt sich dem:der Nutzer:in an und bietet ihm:ihr vermehrt Videos an, die ihn:sie am wahrscheinlichsten interessieren. Der Effekt ist vielen bekannt: man schaut sich ein Video nach dem anderen an und verliert die Zeit aus den Augen. Denn schließlich fühlt man sich gut unterhalten. Würden die angezeigten Videos so gar nicht den eigenen Interessen entsprechen, würden viele schon deutlich eher abspringen.

Durchblick dank der Filterblase

So betrachtet, sind diese Algorithmen zunächst einmal sehr hilfreich – sie verbessern das Nutzungserlebnis ungemein. Denn kaum ein Mensch kann aus über 1,7 Milliarden Websites (Stand: 2019) das für ihn selbst Interessante herausfiltern. Das wäre wie die Suche nach der Nadel im Heuhaufen. Da kommt der Algorithmus doch gerade recht, der die Nadel schon mal für uns raussucht, das Heu beiseiteschiebt und uns die Suche damit erheblich erleichtert. In seiner persönlichen Filterblase fühlt man sich gut unterhalten, man fühlt sich verstanden und profitiert davon.

In den Medien wird die Filterblase teils stark kritisiert. Den Algorithmen wird vorgeworfen, dass sie die Weltsicht der Nutzer:innen verzerren, da ihnen keine neutralen, sondern nunmehr personalisierte Inhalte angezeigt werden. Aber ist das in der Realität anders? Wenn man ins Kino geht, wählt man schließlich auch den Film aus, der den eigenen Genrevorlieben entspricht. In einem Zeitungskiosk greift man zu dem Magazin, das die eigenen Interessen widerspiegelt. Ein Restaurant sucht man sich nach seinem Geschmack aus und genau genommen ist selbst das soziale Umfeld ein selektiertes, denn seine Freund:innen sucht man sich bekanntlich auch selber aus. Wir selektieren im Alltag eigentlich ständig.

Selektion ≠ Filter

Doch genau darin besteht der Unterschied: Selbstbestimmte Selektion ist nicht dasselbe wie ein automatischer Filter. In der Realität treffen Menschen ihre Auswahl für gewöhnlich selbst, während die Algorithmen im Internet quasi für sie auswählen – und ihnen somit gar keine Alternativen anbieten. Oftmals sind sich Internetnutzer:innen dieser bereits getroffenen Vorauswahl nicht einmal bewusst. Einmal in der Filterblase, so die Kritik, ist es schwer wieder rauszukommen. Dort findet sich schließlich alles, was man befürwortet, gerne liest, sich gerne anschaut etc. Und durch die eigene, ständige Bestätigung dieser Inhalte finden andere, interessensfernere Inhalte kaum bis gar nicht ihren Weg zu den User:innen und bleiben somit außen vor. Damit wird ihnen die Wahlmöglichkeit genommen, sie bekommen ihre eigenen Interessen einfach nur noch gespiegelt – wieder und wieder.

Im Alltag hingegen führen bestimmte Vorlieben nicht dazu, dass andere Angebote ausgeblendet werden. Im Kino bekommt man zunächst einmal alle zur Auswahl stehenden Filme gleichwertig vorgeschlagen. Gleiches gilt für den Zeitungskiosk, die Restaurants und selbst für die Freund:innen. Erst durch den Vergleich mit anderen „Angeboten“ ist eine fundierte Auswahl überhaupt möglich. Wenn nun dieser Vergleich im Internet fehlt und der Algorithmus für uns entscheidet – was macht das dann mit uns? Wie können Internetnutzer:innen dann eine tatsächliche von einer verzerrten Realität unterscheiden, wenn sie sich der gefilterten Inhalte gar nicht bewusst sind? Eine differenzierte Betrachtung der angebotenen Inhalte im Internet ist nur dann möglich, wenn man sich der Algorithmen und der Personalisierung bewusst ist.

Hinzu kommt, dass Algorithmen immer nur eine künstliche Intelligenz bleiben werden. Sie können zwar genau „berechnen“, wie ein Mensch tickt und wofür er sich interessiert, aber sie können nicht exakt vorhersehen, ob und wie sich Geschmäcker und Interessen der Menschen verändern oder ob sie offen für Neues sind. Passiert man auf dem Weg zum indischen Restaurant ein neu eröffnetes Bistro, überlegt man vielleicht: „Oh das sieht interessant aus, vielleicht probiere ich heute mal was Neues?“ Würde dieses Bistro – gemäß den Algorithmen – von vornherein „ausgeblendet“ werden, könnte man es weder wahrnehmen noch darüber nachdenken, ob man es ausprobieren möchte. Denn man rotiert ja in seiner Filterblase.

Ist auch unser Alltag gefiltert?

Ganz so ungefiltert ist die „Offline-Welt“ aber auch nicht, denn auch hier haben bereits Vorselektionen stattgefunden – wenn auch nicht so personalisiert wie im Internet. Schon vor unserer Geburt steht fest, in welche Religion wir ggf. hineingeboren werden. Unser Wohnort entscheidet bereits darüber, in welchem sozialen Milieu wir großwerden. Unsere Eltern entscheiden, mit welchen Medieninhalten wir in jungen Jahren konfrontiert werden und welche sie von uns fernhalten. Unser enger sozialer Umkreis gibt uns bereits politische, aber auch soziale Richtungen und Interessen vor. Auch mit zunehmendem Alter und wachsenden Entscheidungsfreiheiten stoßen wir immer wieder auf vorselektierte Auswahlmöglichkeiten: Die Filmauswahl im Kino ist beschränkt, politische Straßenplakate orientieren sich an der mehrheitlichen politischen Ausrichtung des Stadtviertels und selbst Zeitungen treffen tagtäglich eine Vorauswahl, über welche Geschehnisse sie berichten. Der Filter im Alltag ist nicht auf den Einzelnen personalisiert, aber dennoch auf eine Gruppe von Personen zugeschnitten.

Eigene Meinung trotz Filterblase?

Kritiker:innen der Filterblasen-Theorie geben zudem zu bedenken, dass das Internet nicht nur aus Nachrichteninhalten besteht, sondern viele Menschen mit unterschiedlichen Meinungen, Interessen und politischen Ausrichtungen im Internet in nie dagewesener Form aufeinandertreffen. Dank Web 2.0 macht die interaktive Beteiligung im Internet einen wesentlichen Faktor des Internets aus – das sogenannte Mitmachinternet, z. B. in Form von Kommentaren unter den Nachrichten. Und im Vergleich zum eigenen sozialen Umfeld in der Realität trifft man im Internet beispielsweise häufiger auf Menschen mit gegensätzlichen Meinungen und Ansichten. Zudem haben viele Menschen online über soziale Netzwerke deutlich mehr Kontakte als offline und treffen somit auf mehr Meinungsvielfalt. Daher kann man im Internet gar nicht nur die eigene Meinung widergespiegelt bekommen, so einige Kritiker:innen.

Fazit

Ob die Filterblase unser Realitätsbild nun verzerrt oder nicht, lässt sich nicht pauschal beantworten. Letztlich kommt es auch darauf an, wie sehr ein Mensch an unterschiedlichen Meinungen interessiert ist – oder eben nicht. Denn nur wer in der Realität an den Meinungen anderer und am kritischen Austausch interessiert ist, wird sich auch im Internet auf diverse Nutzer:innenkommentare und kritische Diskussionen einlassen. Wer schon in seinem Alltag nur nach ähnlich gesinnten Leuten und Meinungen Ausschau hält (vgl. Echokammer-Effekt), der wird dieses Verhalten auch im Internet fortführen.

Ein Bewusstsein für die Funktionsweise von Algorithmen und die Filterblase zu entwickeln, ist daher umso wichtiger. Denn nur wer weiß, dass es einen Tellerrand gibt, kann auch über diesen hinausschauen – wenn er denn dazu bereit ist.

1. Duden online: Filterblase, https://www.duden.de/rechtschreibung/Filterblase (zuletzt abgerufen am 12.03.2021).

2. DigitalWiki: Filterblase http://www.digitalwiki.de/filterblase (zuletzt abgerufen am 12.03.2021).

3. Friedrich, Greta: Was ist eine Filterblase?, veröffentlicht am 15.02.2019, in: MADS (mads.de), https://mads.de/was-ist-eine-filterblase/ (zuletzt abgerufen am 12.03.2021).

4. Video: Wie kann per Facebook-Algorithmus eine Filterblase mit einer einseitigen Weltsicht entstehen?, veröffentlicht am 01.08.2017, in: Wissenschaftsreihe Leschs Kosmos: Von Algorithmen und Filterblasen, ZDF.de, https://www.zdf.de/wissen/leschs-kosmos/algorithmen-filterblase-100.html (zuletzt abgerufen am: 15.03.2021).

5. Fischer, Tin: Filterblase?, veröffentlicht am 16.08.2017, in: ZEIT ONLINE, https://www.zeit.de/2017/34/algorithmen-filterblase-meinungen-selbstbetrug (zuletzt abgerufen am: 15.03.2021).

6. Fischer, Tin: Wir Zwerge unter Datenriesen, veröffentlicht am 11.02.2017, in: Neue Zürcher Zeitung, https://www.nzz.ch/feuilleton/filterblasen-und-aufgeblasene-thesen-wir-zwerge-unter-datenriesen-ld.144971 (zuletzt abgerufen am: 15.03.2021).

Jenny F. Schneider arbeitet seit 2012 als freiberufliche Medienpädagogin und führt medienpädagogische Fortbildungen, Workshops, Projekttage und Elternabende in KiTas, Schulen, Hort und im außerschulischen Bereich durch. Bei der Freiwilligen Selbstkontrolle Fernsehen (FSF) wirkte sie u. a. bei der Studie Scripted Reality auf dem Prüfstand, der Aktualisierung des Projekts Faszination Medien sowie der Umsetzung und redaktionellen Gestaltung von Medienradar mit.

[Bild: privat]

- Erklärvideo

- Erklärvideo

- Interview

- Ein Interview über verschiedene Aspekte von Verschwörungstheorien

- Zahlen / Fakten

- Ergebnisse der JIM-Studie 2023